Microsoft afirma que su nueva herramienta puede corregir las alucinaciones de la IA

Microsoft afirma tener la solución para corregir las "alucinaciones" de la inteligencia artificial, un problema conocido que afecta a los modelos generadores de texto. En el contexto de la inteligencia artificial, las "alucinaciones" son respuestas o afirmaciones incorrectas, inventadas o irrelevantes que un modelo generador de texto produce.

Este problema se produce cuando estos modelos, no entienden realmente el significado de las palabras ni la realidad detrás de ellas, sino que generan texto basándose en patrones aprendidos a partir de grandes cantidades de datos.

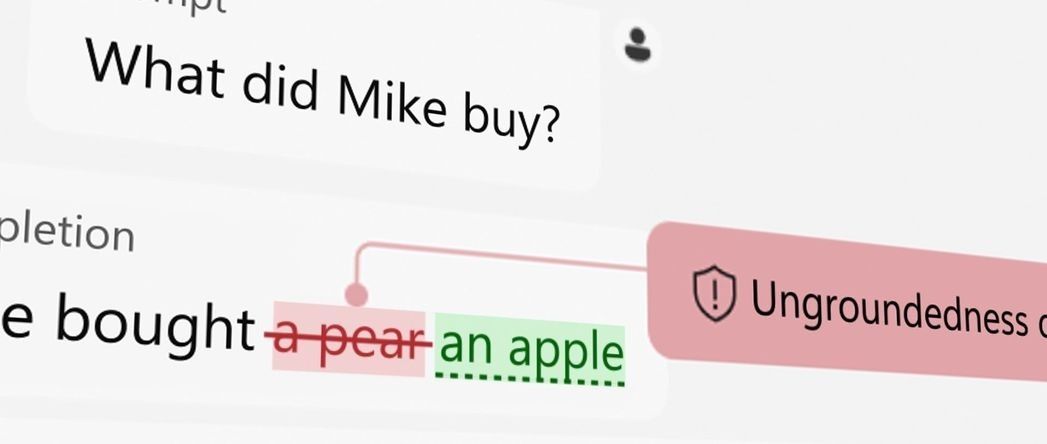

La empresa lanzó "Correction", un servicio que busca detectar y corregir información incorrecta generada por la IA. Esta herramienta, integrada en la API de seguridad de contenido de IA de Azure, está diseñada para trabajar con cualquier modelo de IA generador de texto, como GPT-4 de OpenAI o Llama de Meta.

El funcionamiento de Correction implica la identificación de fragmentos de texto potencialmente erróneos y su posterior verificación con fuentes confiables, como transcripciones o documentos. Según Microsoft, este servicio mejorará la fiabilidad de los sistemas de IA, especialmente en áreas donde la precisión es crucial, como la medicina. Un portavoz de Microsoft señaló que la corrección "ayudará a alinear los resultados de la IA con los documentos de base", lo que, en teoría, reducirá los errores factuales.

Sin embargo, expertos como Os Keyes, candidato a doctorado en la Universidad de Washington, advierten que este enfoque no resuelve el problema subyacente de las alucinaciones. Keyes argumenta que las alucinaciones son una parte intrínseca del funcionamiento de los modelos de inteligencia artificial. "Intentar eliminar las alucinaciones de la IA es como intentar eliminar el hidrógeno del agua", señala.

A nivel comparativo, Google también ha lanzado herramientas similares en su plataforma Vertex AI, que permiten a los usuarios "fundamentar" los modelos con datos externos o de la propia búsqueda de Google. No obstante, los críticos de estos sistemas sostienen que, aunque pueden reducir algunos errores, también podrían inducir a una falsa sensación de seguridad en los usuarios.