La inteligencia artificial que genera imágenes a partir de un texto

OpenAI destaca desde hace un tiempo por ser de las entidades que más avances han provocado en el campo de la inteligencia artificial. En esta ocasión han presentado dos nuevos proyectos llamados DALL-E y CLIP.

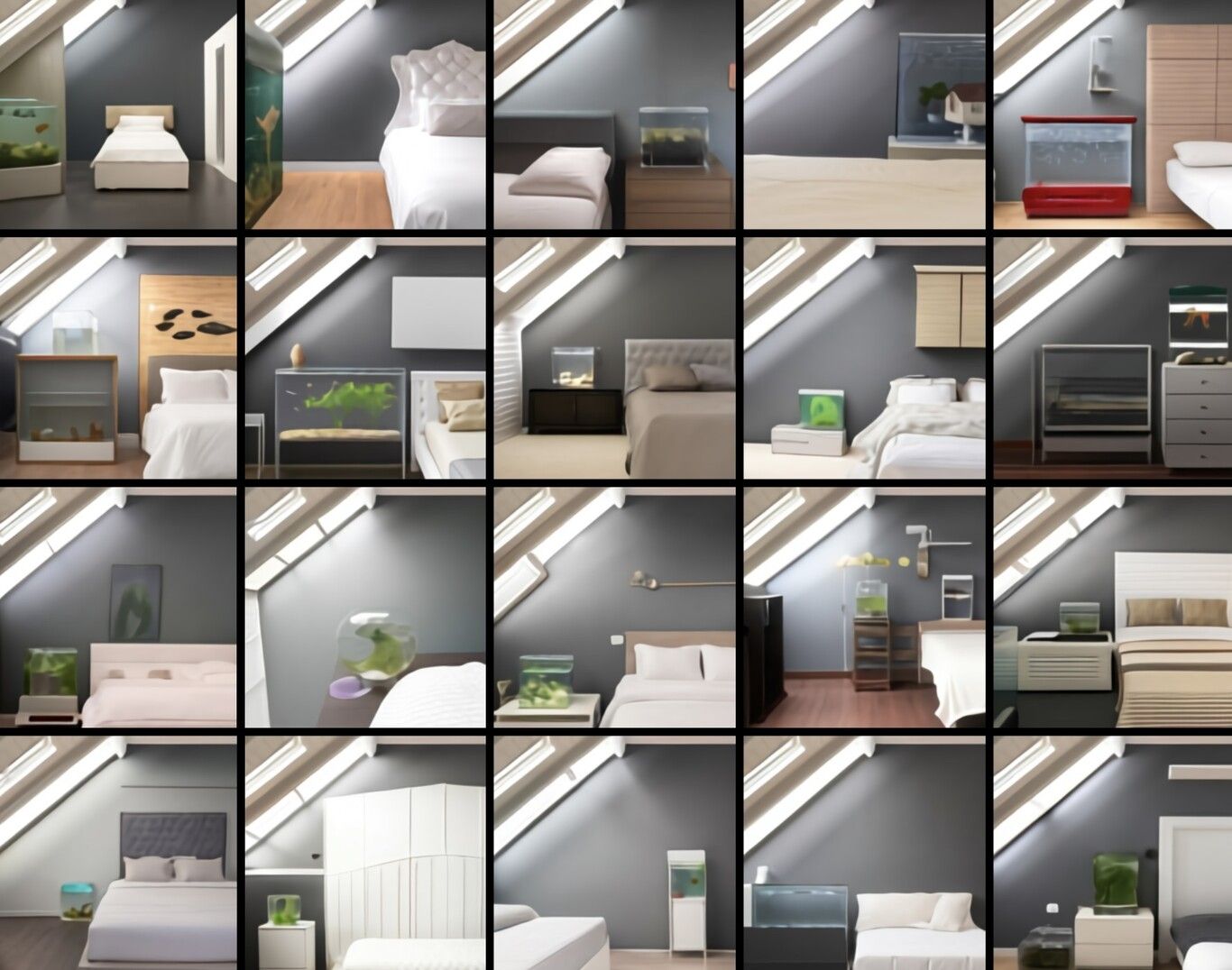

Estas inteligencias pueden asociar imágenes y texto a partir de millones de parámetros GPT-3. Si se le solicita a la IA que nos grafique una cama con una pecera, nos entrega varias imágenes con estos objetos, dispuestos de manera distinta.

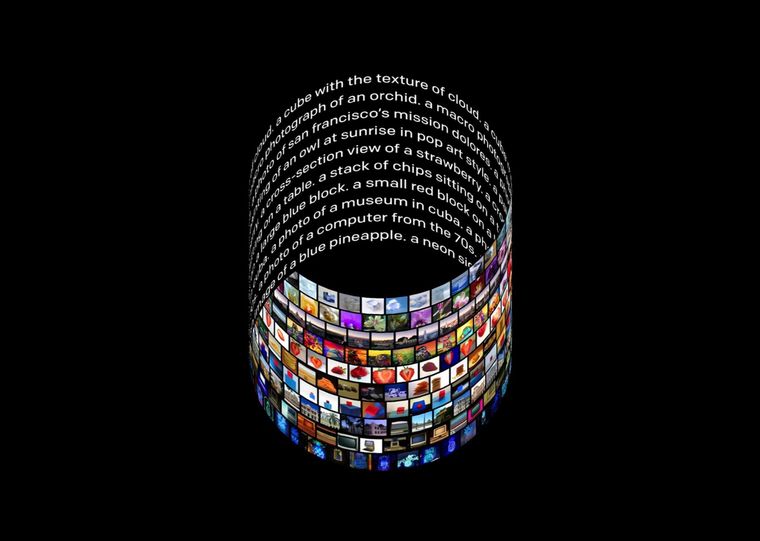

En el caso de ambas IA, se trata de que la asociación entre el texto y lo visual, mejore cada vez más. Por el lado de DALL-E, tenemos un generador de imágenes a partir de un texto descriptivo. Y por el lado de CLIP, tenemos una inteligencia que reconoce imágenes y las categoriza inmediatamente.

Las dos IA se basan en GPT-3, que es un lenguaje creado por OpenAI y presentado durante 2020. Este modelo de lenguaje puede diseñar, charlar (o discutir) y programar.

El propósito de DALL-E es el de generar imágenes de la nada, pero basadas en una descripción antes establecida. Para lograr el objetivo, la IA se basa en 12 mil millones de parámetros de la versión GPT-3. Esto le da la oportunidad de generar distintas versiones de la misma imagen.

Un aspecto interesante a tener en cuenta es cuando la IA genera imágenes de algo que no existe. O sea, puede generar sin inconvenientes la fotografía de una nuez, pero tampoco tiene problemas para establecer la imagen de un reloj verde con forma pentagonal.

Si bien las imágenes no llegan a tener la calidad de una fotografía, los objetos más simples tienen una buena definición y se logran ver perfectamente.

Por otro lado, CLIP, realiza el proceso contrario. Esta IA estudió 400 millones de partes de imágenes y de texto. Gracias a esto, logra reconocer inmediatamente la categoría a la que pertenecen las imágenes. CLIP puede describir una imagen a la perfección.